Con la inteligencia artificial se pueden imitar y copiar voces de manera bastante realista. Hay modelos avanzados de clonación de voz que pueden aprender el tono, timbre y estilo de hablar de una persona con solo unos minutos de audio. Estos sistemas pueden luego generar frases nuevas con esa voz, incluso en diferentes idiomas o con distintas emociones.

Algunas aplicaciones de esta tecnología incluyen:

✅ Doblaje y narración en películas, series o audiolibros.

✅ Asistentes virtuales con voces personalizadas.

✅ Restauración de voces para personas que han perdido la capacidad de hablar.

✅ Música y entretenimiento, donde artistas pueden “cantar” sin grabar.

Sin embargo, también hay riesgos, como el uso fraudulento en deepfakes o estafas telefónicas, por lo que muchas plataformas están implementando medidas de seguridad para evitar el mal uso. Ahora bien, ¿qué no debemos hacer para no quedar expuestos? Para no quedar expuestos a que copien o imiten nuestra voz con IA, aquí hay algunas precauciones clave:

TE NECESITAMOS

TE NECESITAMOS

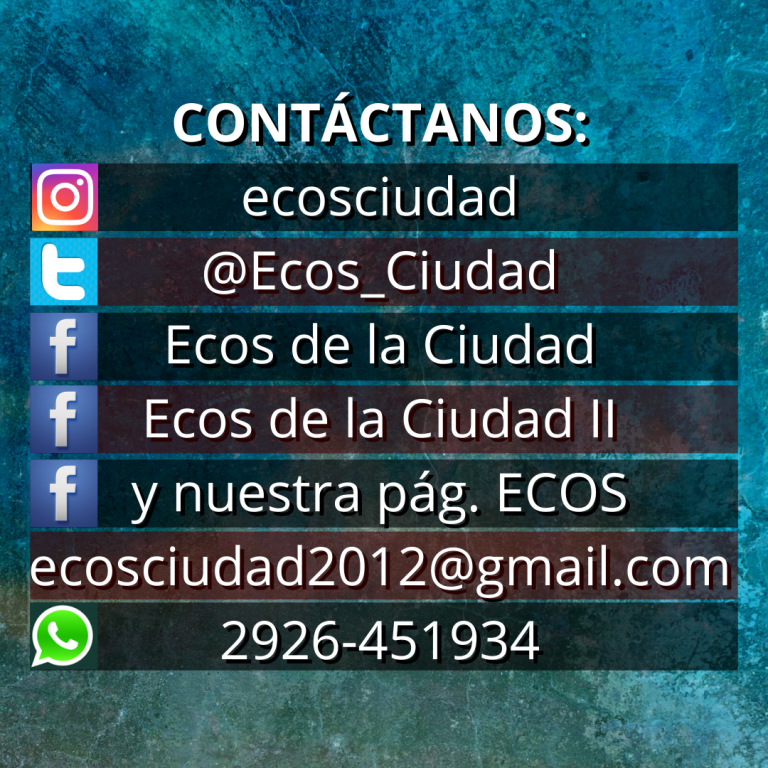

El periodismo social y comunitario está desapareciendo por no tener sustentos. ECOS sobrevive gracias a la vocación de sus editores y la colaboración de corazones solidarios que cada mes nos ayudan con donaciones. Pero es muy poco, ¡¡NO ALCANZA!! y necesitamos que tomes conciencia de que sin un compromiso de todos en el sostenimiento, quienes hacemos esto tendremos que dejar de hacerlo. Hazlo hoy, ya que mañana podría ser tarde.

🔒 Protección de tu voz

✅ Evita compartir audios largos en público: No subas grabaciones extensas de tu voz en redes sociales o plataformas abiertas. Con solo unos segundos, algunas IA pueden clonarla.

✅ Ten cuidado con llamadas desconocidas: No respondas “Sí” o frases largas a números desconocidos, ya que pueden grabarlas para hacer fraudes.

✅ Usa códigos de seguridad: Si manejas información importante, acuerda con familiares o empleados una palabra clave secreta para verificar llamadas legítimas.

🛑 Protección en redes y plataformas

✅ Revisa la configuración de privacidad: En apps de voz o reuniones virtuales, asegúrate de que solo personas de confianza puedan acceder a tus audios.

✅ Evita filtros de voz en apps no confiables: Algunas pueden almacenar y usar tu voz sin tu permiso.

🚨 Cómo detectar y reaccionar ante un fraude de voz

✅ Sospecha de llamadas inusuales: Si alguien suena como un ser querido pero pide dinero o información urgente, verifica por otro medio.

✅ Denuncia deepfakes o suplantaciones: Si ves o escuchas contenido falso con tu voz, repórtalo en la plataforma donde se publicó.

Con estas medidas, es más difícil que usen tu voz sin permiso.

Ayúdanos a sostener nuestro trabajo con una pequeñísima donación.

Ayúdanos a sostener nuestro trabajo con una pequeñísima donación.